Managed Kubernetes

Die zukunftsweisende Container-Orchestrierung

Inhaltsverzeichnis

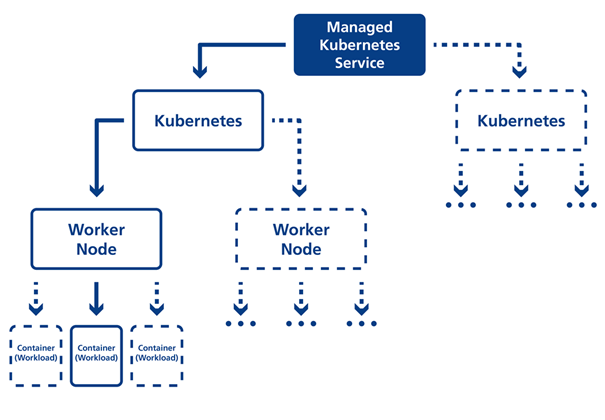

Mit Managed Kubernetes betreiben Sie containerisierte Software standardisiert und zuverlässig – unabhängig vom Einsatzort. Vollautomatisierte Kubernetes-Cluster ermöglichen Ihnen ein Höchstmaß an Skalierbarkeit und Flexibilität.

Moderne Softwareentwicklung ist geprägt von Veränderung und Komplexität: Containerisierte Anwendungen, verteilte Systeme und Microservice-Architekturen haben das Software-Deployment grundlegend verändert. Während traditionelle Infrastrukturen an ihre Grenzen stoßen, schafft Kubernetes flexible, automatisierte Abläufe, selbstheilende Systeme und eine dynamische Ressourcenverteilung.

Womit Unternehmen bei Container-Orchestrierung kämpfen

Skalierbarkeit

Unternehmen kämpfen mit starren Infrastrukturen, die nicht flexibel auf Lastspitzen reagieren können. Manuelle Skalierung von Containern führt zu Ineffizienz und hohen Betriebskosten. In einer containerisierten Umgebung wird die Fähigkeit zur dynamischen Skalierung zum entscheidenden Wettbewerbsvorteil.

High Availability & Fehlertoleranz

Traditionelle Systeme haben keine automatischen Mechanismen, um ausfallende Container zu ersetzen. Dies führt zu Downtime und manuellen Wiederherstellungsprozessen. In verteilten Containerumgebungen ist Hochverfügbarkeit keine Option, sondern zwingende Voraussetzung für stabile Anwendungen.

Komplexes Deployment

Software-Updates bedeuten oft komplexe und risikoreiche Prozesse mit potenziellen Ausfallzeiten. Unternehmen benötigen Strategien für nahtlose, kontrollierte Aktualisierungen. Bei Microservice-Architekturen wird ein fehlerfreies Deployment zum Schlüsselfaktor für Systemstabilität.

Netzwerkkomplexität

Die Kommunikation zwischen verschiedenen Diensten und Containern ist technisch anspruchsvoll. Traditionelle Ansätze erfordern manuelle Netzwerkkonfigurationen. Mit zunehmender Containerisierung wird ein intelligentes Netzwerkmanagement zur Grundvoraussetzung.

Ressourcenmanagement

Ohne intelligente Verteilung verschwendern Unternehmen Rechenkapazitäten und zahlen für ungenutzte Ressourcen. Die optimale Platzierung von Workloads ist eine massive Herausforderung. Effizientes Ressourcen-Scheduling wird zum Schlüssel für kostenbewusste Cloud-Infrastrukturen.

Ihnen kommen diese Herausforderungen bekannt vor? Gemeinsam können wir sie lösen und Ihr Unternehmen zukunftfähig aufstellen

Wie Kubernetes Unternehmen optimieren kann

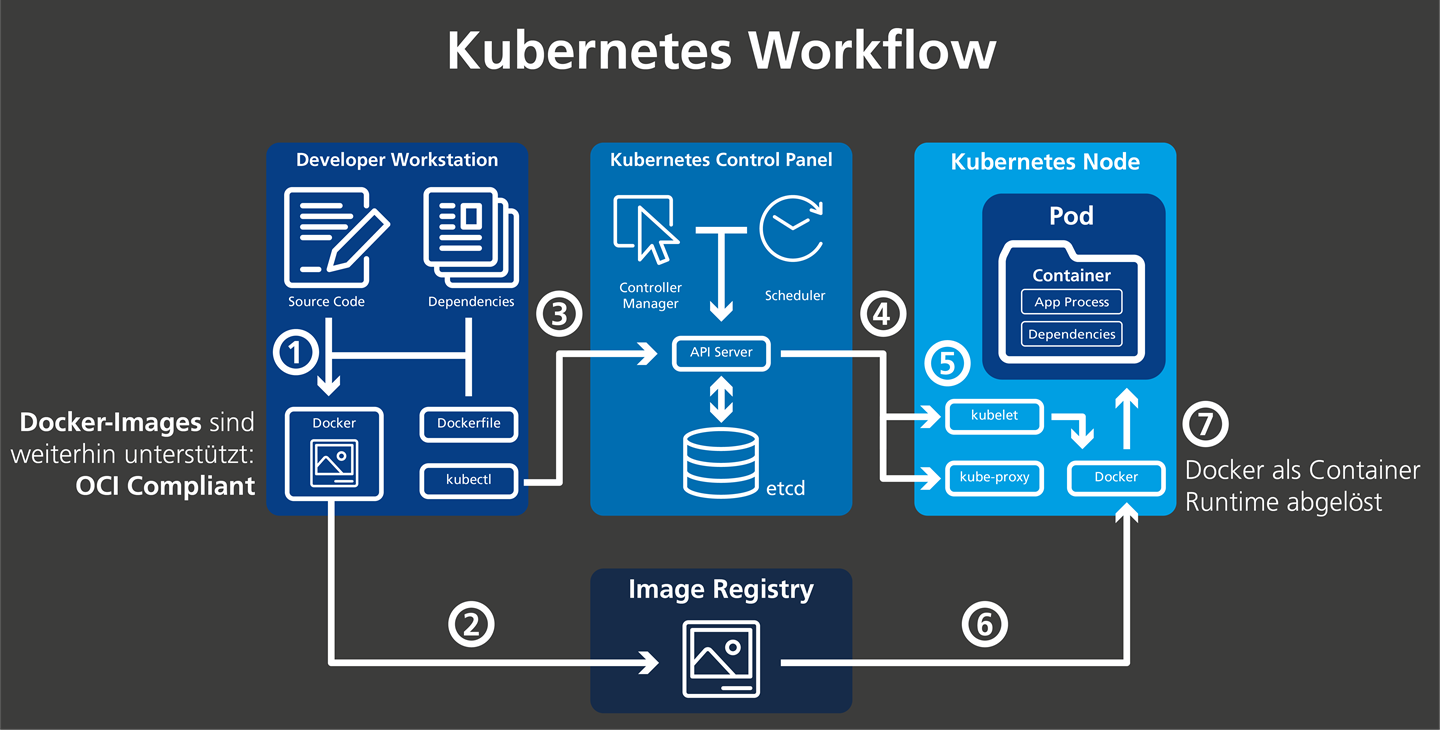

Kubernetes (abgekürzt K8s) ist eine Open-Source-Orchestrierungsplattform, die Softwareentwicklern und IT-Administratoren die automatische Verwaltung von containerisierten Anwendungen ermöglicht. Dazu gehören Aufgaben wie Bereitstellung, Skalierung, Überwachung und Betrieb.

Kubernetes koordiniert dabei die gesamte benötigte Computer-, Netzwerk- und Speicherinfrastruktur – sei es im lokalen Rechenzentrum oder in der Cloud bei Anbietern wie AWS, Azure oder Google Cloud. So können Unternehmen ihre IT-Ressourcen effizienter und flexibler nutzen.

Warum Kubernetes allein nicht reicht

Obwohl Kubernetes den Betrieb großflächiger Container-Landschaften vereinfacht, erfordert die effiziente Nutzung umfassendes Know-how. Implementierung, fortlaufende Wartung, Updates und Monitoring können aufwändig und komplex sein.

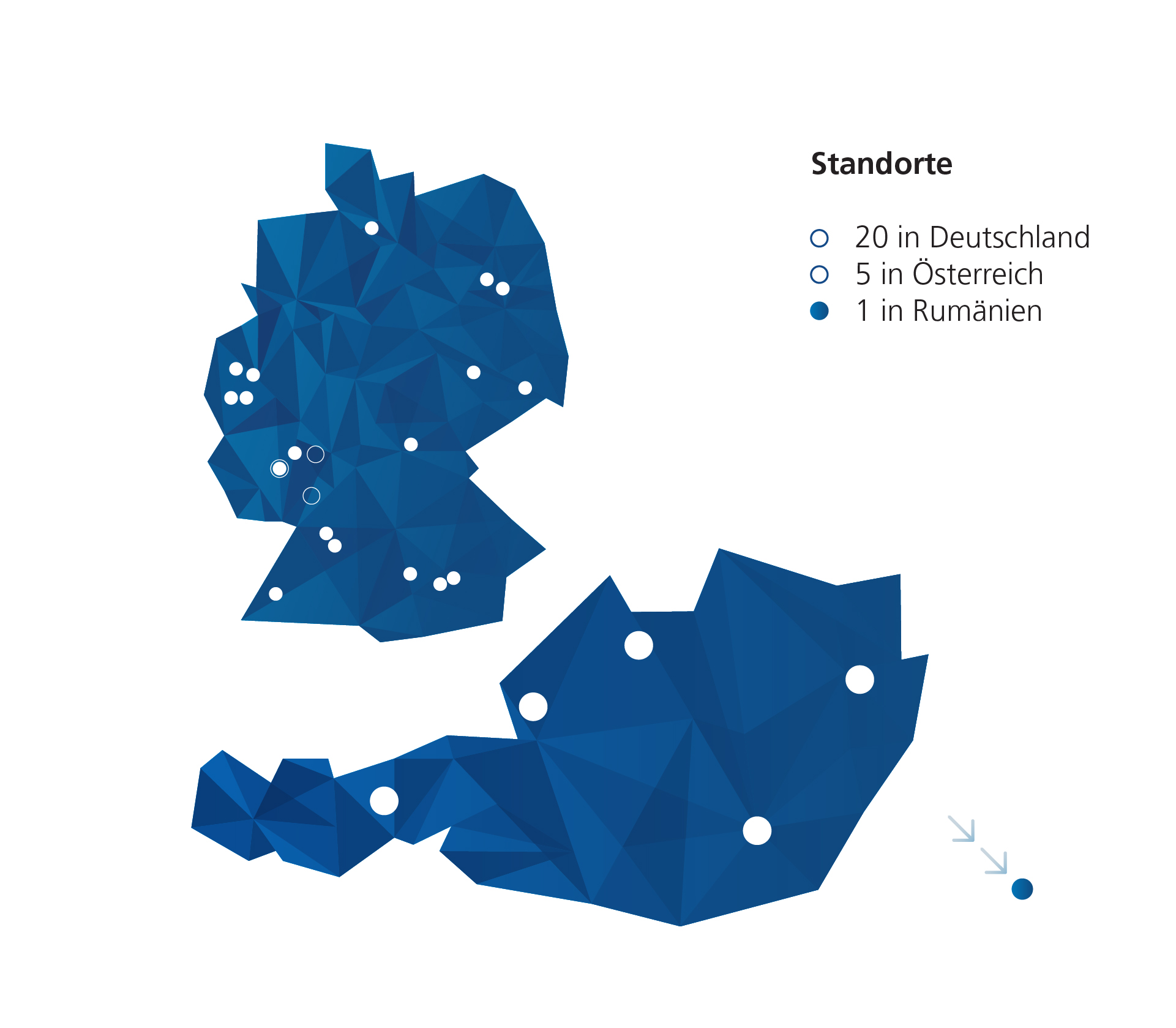

Eine Managementplattform wie die von Medialine vereinfacht diese Prozesse durch automatisierte Workflows. So bündeln Sie die Vorteile von Infrastructure as a Service (IaaS) mit nutzerfreundlichen Self-Service-Portalen. Für den zuverlässigen und produktiven Betrieb ist ein kompetentes Managementteam notwendig.

Ihr Vorteil mit Medialine

Über ein Self-Service-Portal verwalten Sie Ihren Managed Kubernetes Service komfortabel und können eigene Systeme sowie SaaS-Anwendungen einfach integrieren. Wir unterstützen Sie dabei, Legacy-Systeme und containerisierte Workloads zu verbinden und bieten dank moderner Multi-Tenancy-Lösungen größtmögliche Flexibilität – egal, ob Ihre Ressourcen bei uns, bei Ihnen (on Premises) oder in der Public Cloud liegen.

Sie erhalten ein dediziertes Kubernetes-Cluster, können alle Ressourcen zentral einsehen und selbst konfigurieren – von CPU bis Storage. So passen Sie Ihr Kubernetes-Cluster exakt Ihren Anforderungen an.

Sie wollen mehr erfahren über Kubernetes?

In einer Ära, in der Agilität und Skalierbarkeit von Anwendungen eine entscheidende Rolle bekommen, hat sind Containerisierung und Kubernetes die Gamechanger geworden. Dank Ihnen wurde die Verwaltung und der Betrieb von Anwendungen in den vergangenen Jahren revolutioniert.

In unserem Video zeigen wir Ihnen die Möglichkeiten von Kubernetes & Container-Orchestrierung und welche Vorteile diese bieten.

Q&A

Kontaktformular

Sie interessieren sich für unser Angebot rund um Managed Kubernetes? Kontaktieren Sie uns gerne über das Kontaktformular.